GPU 與 TPU 終極對決:誰才是 AI 發展跳躍式成長的關鍵引擎?

生成式 AI 的軍備競賽已經開打。無論你是企業決策者、開發者,還是科技愛好者,你一定聽過這兩個縮寫:GPU 和 TPU。

NVIDIA 靠著 GPU 成為兆級企業,而 Google 則早在十年前就秘密研發 TPU。究竟這兩者有什麼不同?誰才是 AI 時代的真正霸主?這不是一篇枯燥的硬體規格文,我們將用最直白的邏輯,帶你解構這場矽晶片上的戰爭。

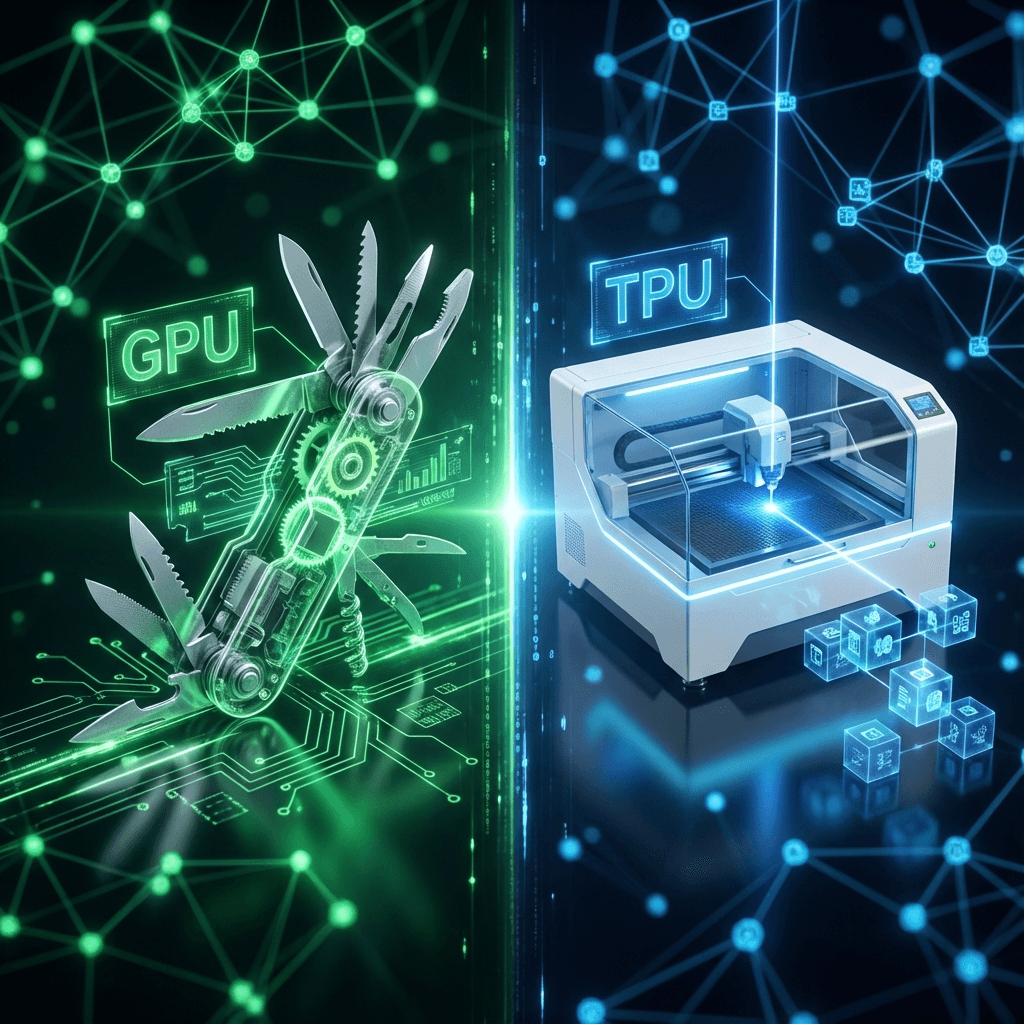

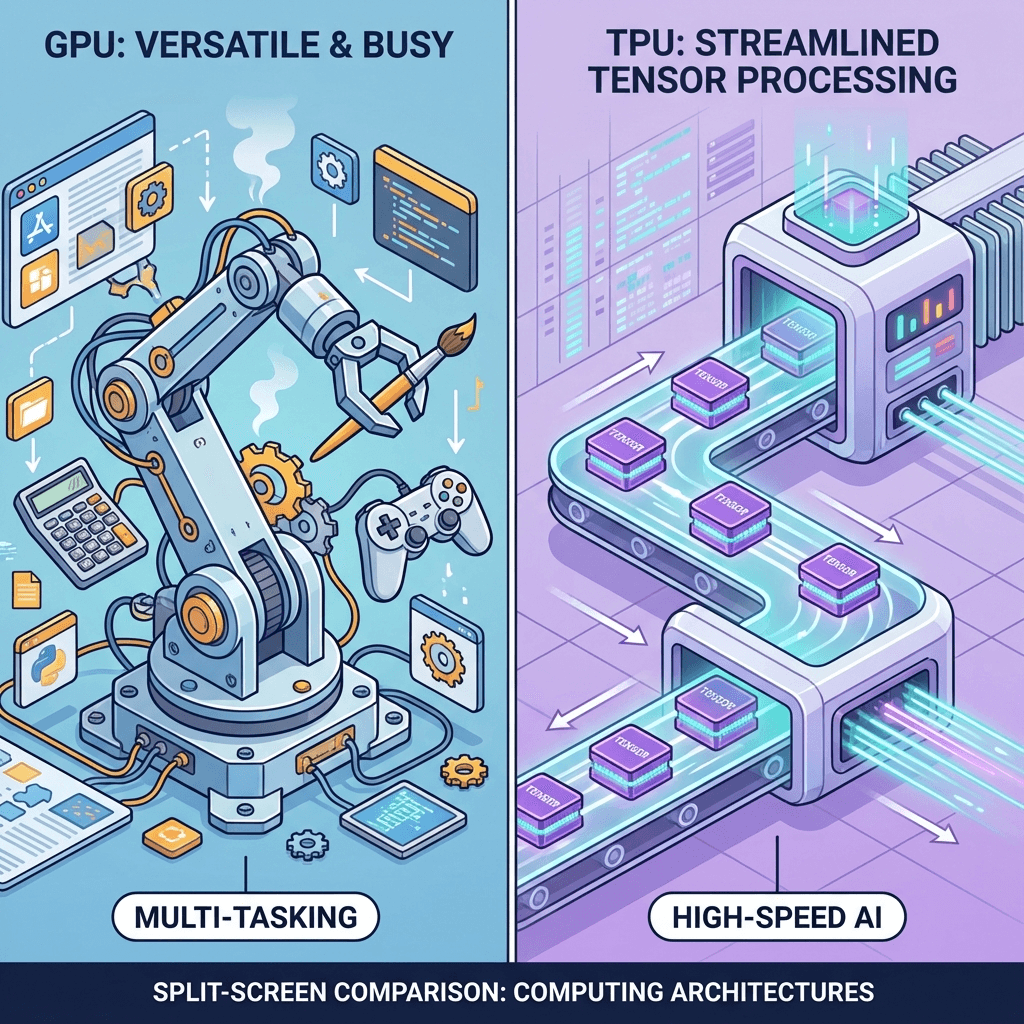

一、 本質差異:瑞士刀 vs. 雷射切割機

要理解 GPU 與 TPU 的差異,最好的方式是看它們的「設計哲學」。

GPU (Graphics Processing Unit)

GPU 最初是為了「玩遊戲」設計的。為了處理遊戲畫面中數百萬個像素的變化,GPU 被設計成擁有成千上萬個小核心,能同時進行大量簡單的運算(平行運算)。這種特性剛好與深度學習的需求不謀而合。

特點: 通用性強。除了跑 AI,它還能繪圖、渲染影片、挖礦。它是「通才」。

TPU (Tensor Processing Unit)

TPU 是 Google 專門為了「機器學習」中的張量 (Tensor) 運算而生的 ASIC (特殊應用積體電路)。它移除了所有與 AI 無關的電路(如光柵化渲染),專注於矩陣乘法。

特點: 專用性極強。跑 AI 飛快、省電,但離開了 AI,它幾乎什麼都不能做。它是「專才」。

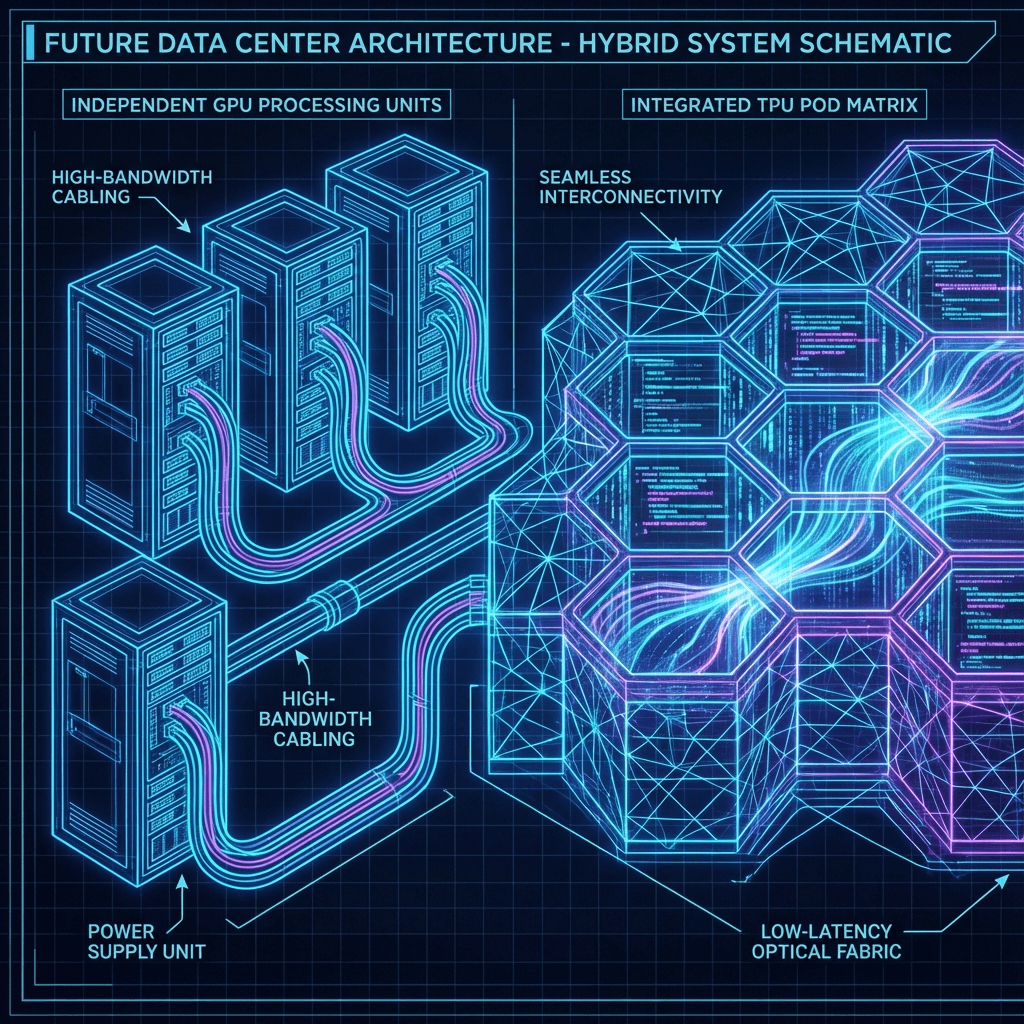

二、 效能與擴展性 (Scaling)

在單卡效能上,NVIDIA 的 H100 GPU 目前是王者。但在「大規模叢集」運算上,TPU 展現了驚人的優勢。

Google 的 Gemini 模型就是完全在 TPU v4/v5 叢集上訓練出來的。TPU 的互連技術 (Interconnect) 讓數千顆晶片能像一顆超級晶片一樣運作,這對於訓練像 GPT-4 或 Gemini 這種兆級參數的模型至關重要。

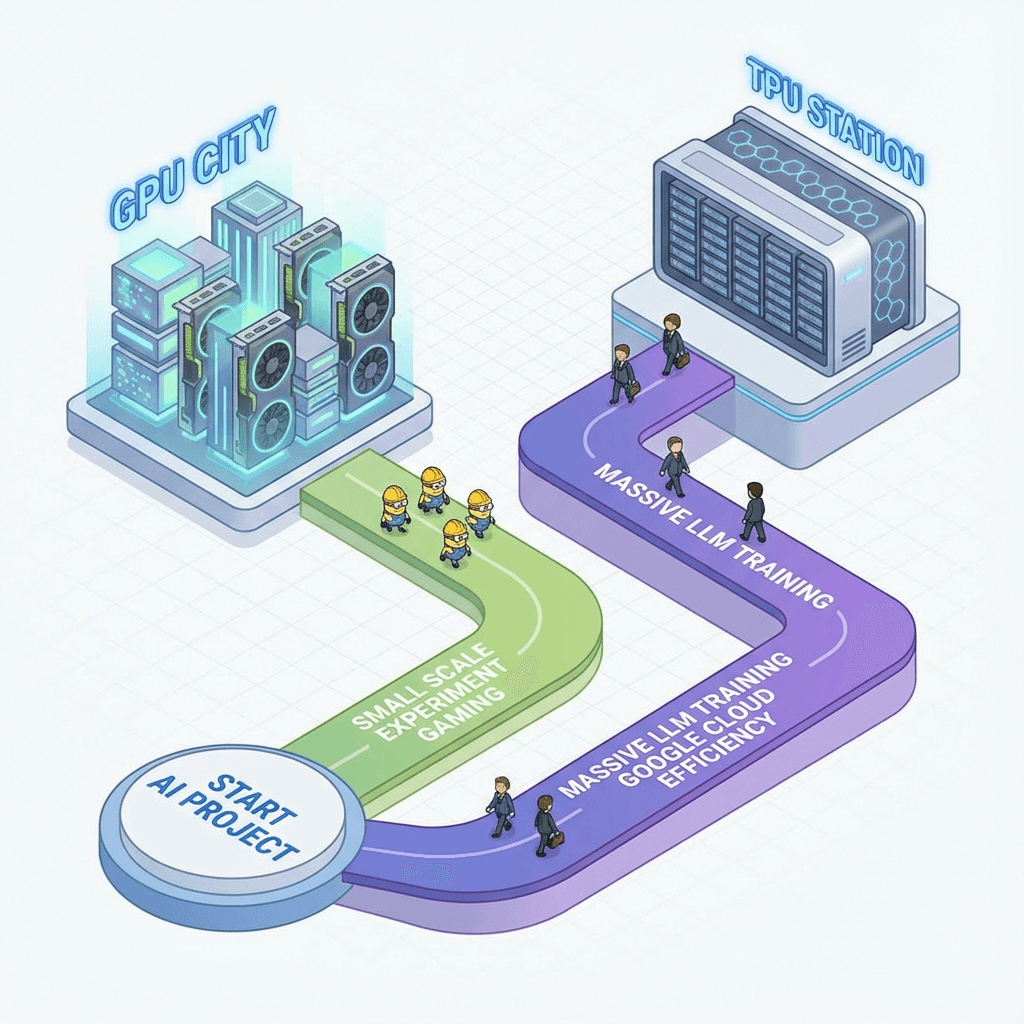

三、 決策指南:你該選哪一個?

這不是非黑即白的選擇,而是「適用場景」的問題。

選擇 GPU 若是...

- 你需要最高的單卡效能與靈活性。

- 你的模型需要頻繁修改架構,且大量依賴開源社群的工具 (CUDA 生態系王者無敵)。

- 你需要做一些非 AI 的運算(如前處理、後處理)。

選擇 TPU 若是...

- 你使用 TensorFlow 或 JAX 框架開發。

- 你需要訓練超大規模的模型,且極度在意「性價比」與「能耗比」。

- 你已經深度整合在 Google Cloud 生態系中。

結語:

GPU 贏在「廣度」與「生態」,它降低了 AI 的入門門檻,讓 AI 遍地開花;TPU 贏在「深度」與「規模」,它推高了 AI 的天花板,讓 AI 智慧達到新的高度。這場對決沒有輸家,因為它們共同推動了人類科技的奇點。

💬 常見 QA

Q1: TPU 可以買回家插在電腦上嗎?

A: 不行。TPU 是 Google Cloud 的獨家雲端服務,你只能租用算力,買不到實體卡 (Edge TPU 除外,那是給物聯網邊緣運算用的)。

Q2: 為什麼 NVIDIA 這麼強?

A: 除了硬體強,NVIDIA 最強大的是 CUDA 軟體生態。全球數百萬開發者都用 CUDA 寫程式,這構成了極深的護城河,讓對手難以跨越。

Q3: 未來會有比 GPU/TPU 更強的晶片嗎?

A: 有。包括 LPU (Language Processing Unit) 等針對特定 LLM 推論優化的晶片正在崛起 (如 Groq),專注於極致的生成速度。